В апреле 2026 года компания Anthropic отказалась от публичного релиза своей новой модели искусственного интеллекта Claude Mythos. Не потому, что эта модель работает плохо, а потому, что слишком хорошо: она находила уязвимости в коде, который специалисты и автоматические инструменты проверяли десятилетиями и не замечали. Модель оказалась настолько сильна, что ее решили не выпускать в открытый доступ, предоставив лишь нескольким десяткам компаний-партнеров.

Сама по себе эта история могла бы быть просто новостью из мира технологий. Но она точно иллюстрирует нечто большее.

Машина делает то, что не удавалось лучшим специалистам. А мы все еще спорим, настоящий ли это интеллект.

И проблема не в том, что у нас нет ответа. Проблема в том, что критерии подбираются задним числом, каждый раз заново, по мере того, как машина преодолевает очередную планку.

Интеллект — это то, чего машины еще не делают

В 1970-е годы исследователь Ларри Теслер сформулировал наблюдение, ставшее известным как «теорема Теслера»: «Интеллект — это то, чего компьютеры еще не делают» (Intelligence is whatever machines haven’t done yet). Это была не шутка, а фиксация реального явления: каждый раз, когда машина осваивала новую когнитивную способность, определение интеллекта сдвигалось так, чтобы эта способность больше «не считалась».

Когда Deep Blue обыграл Каспарова*, нам сказали: шахматы это просто перебор вариантов, не настоящий интеллект. Когда нейросети научились распознавать лица лучше людей — это «просто паттерны». Когда GPT начал писать связные тексты — «просто статистическое автодополнение». Горизонт интеллекта отступал каждый раз, когда машина к нему приближалась.

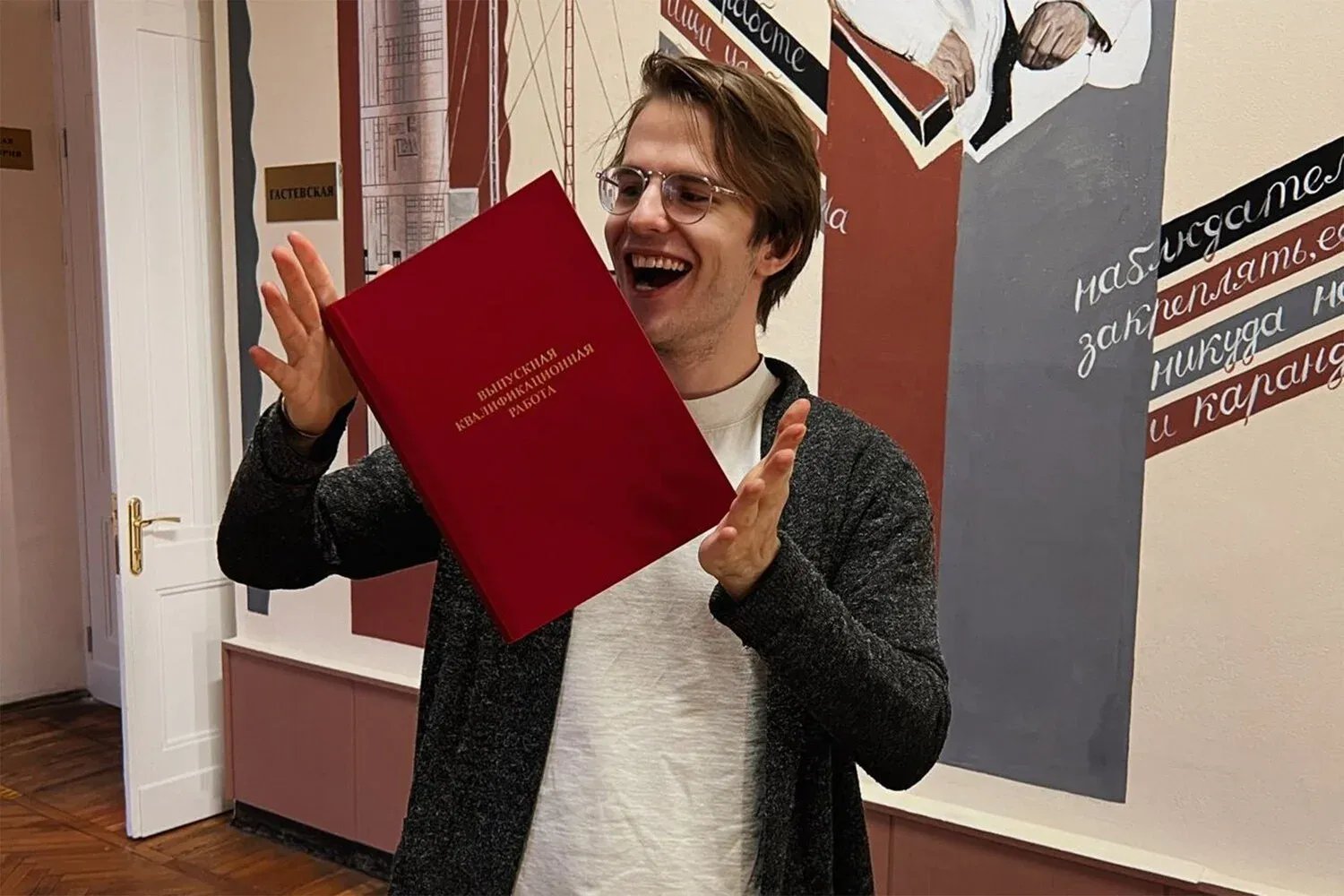

ИИ уже пишет сочинения лучше среднего ученика, сдает экзамены на уровне выше среднего, решает задачи, которые ставят в тупик студентов. Первым громким кейсом в стране была защита в РГГУ в 2023 году дипломной работы, написанной ChatGPT, появившимся всего за полгода до этого. Скандал шумел в медиа неделями, но суть была проста: бездушная машина справилась с заданием, которое должно было проверять человеческий интеллект. И реакция системы образования оказалась показательной: не «значит, что это проявление интеллекта» или хотя бы «наши привычные практики больше не работают» (впрочем, не работают они уже очень давно), а «значит, наши экзамены недостаточно строго регламентированы».

С тех пор планка поднималась не раз. Большая языковая модель GPT-4.5 прошла тест Тьюринга (с ответом на вопрос, с человеком или компьютером идет разговор), будучи принятой за человека в 73% случаев, тогда как участвовавшие в эксперименте люди признавались людьми только в 67%.

А в начале 2026 года языковые модели помогли решить десятки задач из наследия Пола Эрдеша, одного из крупнейших математиков XX века, — задач, которые оставались нерешенными десятилетиями. Скептики тут же уточнили: часть решений свелась к поиску существующих доказательств, а не к созданию новых. Но даже этого люди не сделали. Попробуйте назвать это всего лишь простым «автодополнением».

Скептический взгляд: «это не настоящее понимание», «нет модели мира», «просто копируют закономерности». Тут, конечно, возникает вопрос создания своего теста, который бы показал, что с этими характеристиками у людей. Глядя на сошедший с ума мир, можно прийти к выводу, что не так уж много людей обладает реальным пониманием происходящего.

И теорема Теслера продолжает работать безотказно. Вопрос лишь в том, сколько еще раз горизонт может отступить, прежде чем мы признаем, что он давно пройден.

Двойные стандарты человека

Все выглядит так, что мы предъявляем к машине требования, которых никогда не предъявляли к себе, и одновременно принимаем собственную надежность как данность. Да, ИИ «галлюцинирует», и механизмы его ошибок отличаются от человеческих. Но и люди подвержены ложным воспоминаниям и предвзятости; закономерность одна и та же. Психологические исследования десятилетиями документируют, как люди «вспоминают» события, которых не было, и уверенно отстаивают убеждения, не имеющие фактической основы. Отсутствие модели мира (кстати, а есть ли она у читателя?) тем не менее позволяет искусственному интеллекту верно предсказывать последствия физических действий и помогать в инженерном проектировании. Ошибки в простых вещах? Но всегда ли прав человек и безграничны его знания?

Скептики говорят: ИИ требует для обучения несопоставимо больше данных, чем ребенок. Это правда, но разве все мы схватываем одинаково? Кому-то нужно долго разъяснять, а кому-то понятно с полуслова.

Когда врач ставит неверный диагноз, мы не говорим «медицина бессмысленна». Когда навигатор прокладывает неоптимальный маршрут, мы не выбрасываем телефон. Но стоит ИИ один раз выдать несуществующую ссылку, и следует приговор: «Это всё игрушки, ему нельзя доверять».

Ларри Теслер. Фото: АР

Если бы речь шла только о бытовых предрассудках, проблема не стоила бы статьи. Но двойные стандарты начинают закрепляться институционально. В образовании выстраивается целый арсенал практик, основанных на презумпции ненадежности ИИ: запреты, системы детекции, требования «доказать, что написал сам». При этом симметричной проверки человеческих результатов нет. Студент может списать у однокурсника, пересказать чужие идеи без ссылки — и это проверяется куда менее строго.

Более того, сами задания давно проверяют не понимание, а способность воспроизводить шаблоны — ровно то, что машина делает не хуже человека. В корпоративной среде та же картина: регламенты проверки того, что выдала система, есть, а регламентов проверки того, что выдал сотрудник, нет. Человеческий результат надежен по умолчанию, машинный подозрителен. Любой, кто работал с аналитическими отчетами, знает, насколько это допущение оптимистично.

В регулировании закладываются требования к точности, прозрачности и объяснимости, которые никогда не предъявлялись к людям, выполняющим аналогичные функции. Это не значит, что требования не нужны: они необходимы. Но их асимметричность создает искаженную картину.

Машина кажется ненадежной не потому, что она менее надежна, а потому, что ее надежность измеряется, тогда как человеческая принимается на веру.

Один из самых недооцененных аспектов проблемы: механизм, порождающий «галлюцинации», неотделим от механизма, порождающего творческие способности.

В основе работы языковой модели лежит обманчиво простой принцип: предсказание наиболее вероятного продолжения текста. В реальности механизм устроен значительно сложнее, но эта базовая логика сохраняется — и именно она порождает парадокс. Когда продолжение совпадает с фактами, мы получаем точный ответ. Когда не совпадает, получаем «галлюцинацию». Но когда модель комбинирует известное неожиданным образом, находит связи, которых раньше никто не замечал, предлагает нестандартное решение, работает тот же принцип: свобода комбинирования. Ошибки и открытия растут из одного корня. Разработчики учатся подрезать первое, не повредив второму, но само напряжение между точностью и свободой никуда не исчезнет — оно встроено в природу любого мышления, не только машинного.

Воображение и заблуждение — соседние комнаты с общей дверью, и это верно не только для машин. Человек, который никогда не ошибается, — это человек, который никогда не рискует, не строит гипотез, не выходит за рамки известного. Требовать от ИИ безошибочности — значит требовать от него отказа от того, что делает его по-настоящему полезным для интеллектуальной работы, — и чего мы не требуем от самих себя.

Двойные стандарты — это институциональная сторона проблемы. Но есть и бытовая, не менее причудливая.

Чего мы хотим от машины?

Люди бросились спрашивать у ИИ всё подряд, фактически используя его вместо верифицированных источников, и возмущаются, когда результат оказывается не таким, как в серьезном академическом источнике. Но те же самые люди десятилетиями принимали первую ссылку в Google за истину. Верификация никогда не была массовой практикой, и искусственный интеллект просто напомнил об этом.

Интересно наблюдать, как занимающиеся интеллектуальной работой охотно просят у чат-бота обратную связь и принимают ее лучше, чем от живых коллег.

Если критику даст человек, то часто ему скажут, что он не разобрался в теме. Но выдаст ту же критику машина, и реакция иная: «Как интересно, надо подумать». Скорее всего, дело в том, что ИИ находится вне социальной иерархии, его не воспринимают как конкурента. Один знакомый исследователь признался автору, что готов часами обсуждать с чат-ботом слабости собственной теории, хотя от коллеги с аналогичными замечаниями отмахнулся бы. Авторитет критики оказывается обратно пропорциональным приписываемому интеллекту критика.

Но есть и более глубокий парадокс. Часто люди восхищаются тем, как хорошо ИИ «понимает» их идеи. Как мы уже говорили, в основе работы языковой модели действительно лежит предсказание наиболее вероятного продолжения — а значит, в ответе будут так или иначе учитываться слова собеседника, не просто его лексика, но и предпосылки. Когда в ответ приходит нечто созвучное, возникает ощущение глубины.

Сэм Альтман в Стенфорде. Кадр из видео

Но это резонанс, а не понимание. Люди восхищаются отражением собственного мышления, принимая его за независимую экспертизу. И когда машина нас поддерживает и дополняет, ее хвалят за ум. Когда выдает неожиданное — ругают за «галлюцинации». Хотя, если задуматься, именно в момент отклонения от ожидаемого она наиболее близка к творчеству. Мы хотим одновременно двух взаимоисключающих вещей: чтобы ИИ был зеркалом, подтверждал и развивал наши мысли, и чтобы он был окном, показывал что-то новое.

Все описанные парадоксы ведут к одному выводу: проблема не в зрелости или незрелости технологии. Проблема в том, что ИИ работает как зеркало не только в смысле текста. Он обнажает противоречия в нашем отношении к интеллекту вообще, экспертизе, ошибкам и самим себе. Он уже меняет то, как мы думаем и говорим, и делает это незаметно. Достаточно посмотреть на язык: исследователи фиксируют, как характерные обороты и слова из ответов чат-ботов просачиваются в живую речь, в академические тексты, в посты в соцсетях. Люди бессознательно подстраиваются под стиль машины, воспринимая его как образец грамотного, авторитетного языка.

Но есть и обратный эффект, который замечают реже: искусственный интеллект показывает, насколько непоследовательной была наша прежняя «нормальность». Мы привыкли считать человеческое мышление эталоном, а он заставляет увидеть, что этот эталон полон изъянов, которые просто перестали замечать.

Мы не знаем, чего хотим от машины, потому что плохо понимаем, чего ожидаем от самих себя.

Прощаем людям то, что не прощаем искусственному интеллекту. Восхищаемся в ИИ тем, что на самом деле является нашим собственным отражением. И боимся в нем того, что на самом деле говорит о наших собственных ограничениях.

Что такое AGI

Все описанное выше — двойные стандарты, теорема Теслера, парадоксы повседневного поведения — указывает не на то, что искусственный интеллект недооценен или переоценен. Оно указывает на то, что перед нами иная форма интеллекта, с другим профилем сильных и слабых сторон. И у нас нет адекватного аппарата, чтобы понять, с чем мы столкнулись.

Даже среди создателей технологии нет согласия, причем расхождения фундаментальны. Предмет спора обозначается аббревиатурой AGI, artificial general intelligence, «общий искусственный интеллект». Сам термин стал популярным лишь в начале нулевых, после выхода одноименной книги под редакцией Бена Герцеля. Он определял AGI как систему, способную решать интеллектуальные задачи на человеческом уровне, не ограничиваясь одной областью, и подчеркивал, что ей не обязательно быть копией человеческого разума, обладать самосознанием или эмоциями. Достаточно широты, гибкости и способности разобраться в незнакомом.

Андрей Карпатый. Фото: Habr

Достигнуто ли это? В феврале 2026 года в Nature вышла статья Does AI already have human-level intelligence? The evidence is clear («Вышел ли уже ИИ на уровень человеческого разума? Доказательство очевидно»), авторы которой аргументируют ответ на свой вопрос — да. В этом же феврале Сэм Альтман, генеральный директор Open AI, выступая перед студентами Стэнфорда**, заявил: «Если ты сейчас второкурсник, ты окончишь университет в мире, где уже будет AGI». Несколькими месяцами ранее Андрей Карпатый, один из создателей архитектуры, на которой строятся современные языковые модели, говорил противоположное: до AGI еще лет десять, текущие ИИ-агенты «нерабочие», обучение с подкреплением «ужасное». При этом Карпатый, в отличие от руководителей компаний, свободен от необходимости поддерживать нарратив для инвесторов; его скепсис является интеллектуальной позицией, а не маркетинговой. А Дарио Амодей, глава Anthropic, компании, создавшей ту самую модель Mythos, предлагает третью рамку. В эссе The Adolescence of Technology («Подростковый возраст технологий») он описывает происходящее метафорой из «Контакта» Карла Сагана: как нам пережить технологический подростковый возраст, не уничтожив себя? Его формула для того, что уже есть или вот-вот будет: «Страна гениев в дата-центре», — миллионы экземпляров системы, каждый умнее нобелевского лауреата, работают в сто раз быстрее человека. И центральный вопрос для него не «Это интеллект или нет?», а «Обладаем ли мы зрелостью, чтобы с этим справиться?».

Дарио Амодей. Фото: соцсети

Три человека, определивших облик сегодняшнего ИИ, — три принципиально разных ответа. И ни один не может опереться на общепринятое определение того, о чем спорит. Статья в Nature аргументирует, что AGI достигнут. Но важнее другое:

сама попытка провести границу между интеллектуальным поведением среднего человека и поведением ИИ обнаруживает, что мы никогда по-настоящему не определяли, что значит «человеческий интеллект», пока не появилось нечто, претендующее на сравнение.

Скорее всего, мы имеем дело с чем-то принципиально «чужим» — как инопланетяне, недаром в английском для этого используется одно и то же слово alien. Система, которая ошибается в том, что просто для нас, и блестяще справляется с тем, что для нас сложно, не укладывается в привычные категории. Авторы статьи в Nature признают, что перед нами довольно чуждая форма интеллекта, но видят в этом не аргумент «против», а повод расширить само понятие. Амодей, описывая свою «страну гениев», оговаривается: их мотивации могут быть «от полностью послушных до странных и чуждых». Это не человеческий разум в машинной оболочке. Это что-то другое, и мы пока не очень понимаем — что. Несмотря на то что за три с небольшим года почти привыкли говорить об ИИ как о чем-то обыденном.

Возможно, это не так страшно, как кажется. Компьютеры тоже поначалу воспринимались как электронные калькуляторы. То, что на этом можно построить интернет и глобальную экономику данных, стало ясно спустя существенное время. С ИИ, вероятно, происходит нечто похожее: мы видим начало, масштаб которого не способны оценить, и пытаемся описать его в категориях, которые для этого не годятся. Зеркало уже висит перед нами. Вопрос не в том, умное ли оно. Вопрос в том, готовы ли мы посмотреть в него честно.